Nvidia ha anunciado su nueva GPU para aprendizaje automático e inferencia en los centros de datos. La nueva tarjeta Tesla T4 se basa en la arquitectura Turing, y es la sucesora del actual modelo Tesla P4, que cubre prácticamente todos los principales proveedores de computación en nube.

Nvidia Tesla T4 quiere revolucionar los centros de datos

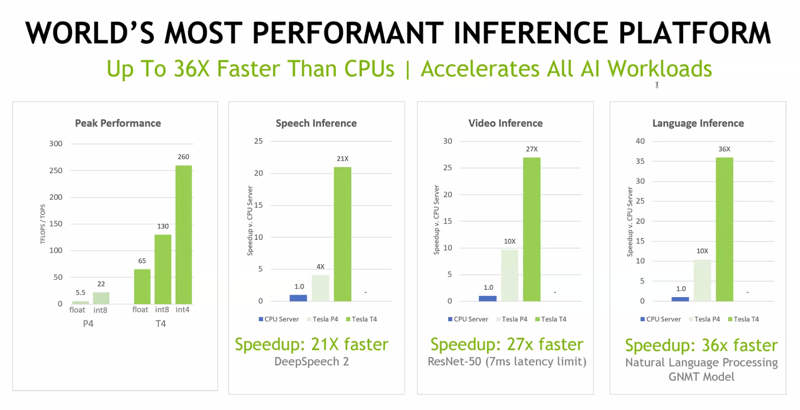

Nvidia argumenta que las Tesla T4 son significativamente más rápidas que las P4. Para la inferencia de lenguaje, por ejemplo, T4 es 34 veces más rápido que usar una CPU y más de 3.5 veces más rápido que P4. El rendimiento máximo para Tesla P4 es 260 TOPS para operaciones enteras de 4 bits y 65 TOPS para operaciones de coma flotante. T4 se encuentra en una tarjeta PCI-e de 75 vatios de perfil estándar.

Te recomendamos la lectura de nuestro post sobre Aparecen detalles de la arquitectura Turing de Nvidia

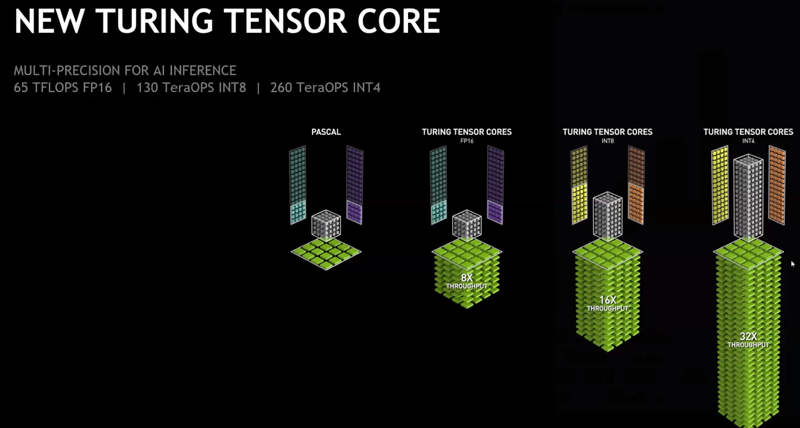

Lo más importante es que Nvidia diseñó estos chips específicamente para la inferencia de IA, lo que hace que Tesla T4 sea una GPU tan eficiente para realizar inferencias es el nuevo núcleo Tensor Core de Turing. Jensen Huang ya habló sobre el nuevo Tensor Core, y lo que puede hacer para jugar, renderizar y para operaciones de AI. En total, el chip presenta 320 Tensor Core Turing y 2,560 núcleos CUDA.

Además del nuevo chip, Nvidia también está lanzando una actualización de su software TensorRT para optimizar los modelos de aprendizaje profundo. Esta nueva versión también incluye el servidor de inferencia TensorRT, un microservicio totalmente contenedorizado para la inferencia de centros de datos que se conecta perfectamente a una infraestructura existente de Kubernetes.

[irp]Turing es una de las arquitecturas más innovadoras de Nvidia, incluso en el mercado gaming donde permitirá por primera vez hacer uso del ray tracing en tiempo real para mejorar el acabado gráfico de los juegos más punteros.